در ۱۳ مه ۲۰۲۴ شرکت OpenAI جدیدترین مدل بزرگ زبانی خود، یعنی GPT-4o، را بهعنوان جانشین GPT-4 Turbo معرفی کرد. این مدل پیشرفته تواناییهای بینظیری در پردازش متن، صدا، تصویر و ویدئو دارد و تحولی شگرف در کاربردهای مختلف هوش مصنوعی ایجاد کرده است. برای اینکه بدانید قابلیتها، عملکرد و نحوه استفاده از Chat GPT-4o چیست با ما همراه باشید.

- 1. Chat GPT-4o چیست و چه کار میکند؟

-

2.

چه چیزی Chat GPT-4o را از GPT-4 Turbo متفاوت میکند؟

- 2.1. توجه به لحن صدا پاسخهای دارای عاطفه را ممکن میکند

- 2.2. کاهش تأخیر امکان مکالمات زمان واقعی را فراهم میکند

- 2.3. بینش یکپارچه توانایی توصیف ورودی دوربین را فراهم میکند

- 2.4. توکنسازی بهتر برای الفباهای غیر رومی: افزایش سرعت و بصرفهترشدن هزینهها

- 2.5. عرضه پلن رایگان

- 2.6. مراحل راهاندازی برنامه دسکتاپ ChatGPT چیست

- 3. Chat GPT-4o چگونه کار میکند؟

- 4. آیا Chat GPT-4o یک تغییر اساسی در مقایسه با GPT-4 Turbo است؟

- 5. عملکرد Chat GPT-4o درمقابل باقی مدلها

- 6. موارد استفاده از Chat GPT-4o چیست

- 7. محدودیتها و ریسکهای Chat GPT-4o چیست

- 8. هزینه Chat GPT-4o چقدر است؟

- 9. چگونه میتوانم به Chat GPT-4o دسترسی داشته باشم؟

- 10. آینده Chat GPT-4o چگونه است؟

- 11. جمعبندی

-

12.

پرسشهای متداول

- 12.1. آیا Chat GPT-4o میتواند مکالمات چندزبانه را مدیریت کند؟

- 12.2. آیا Chat GPT-4o همه زبانها را بهطور یکسان پشتیبانی میکند؟

- 12.3. Chat GPT-4o چگونه نویز پسزمینه در ورودی صوتی را مدیریت میکند؟

- 12.4. آیا Chat GPT-4o قادر به تولید محتوای ویدئویی است؟

- 12.5. آیا Chat GPT-4o میتواند صداهای خاصی را تقلید کند؟

- 13. یادگیری ماشین لرنینگ را از امروز شروع کنید!

Chat GPT-4o چیست و چه کار میکند؟

Chat GPT-4o جدیدترین مدل بزرگ زبانی (LLM) از OpenAI است. حرف o در GPT-4o از کلمه omni بهمعنی همهجانبه است که نشاندهنده این واقعیت است که این مدل جدید میتواند دستورهایی را که ترکیبی از متن، صدا، تصویر و ویدئو هستند بپذیرد.

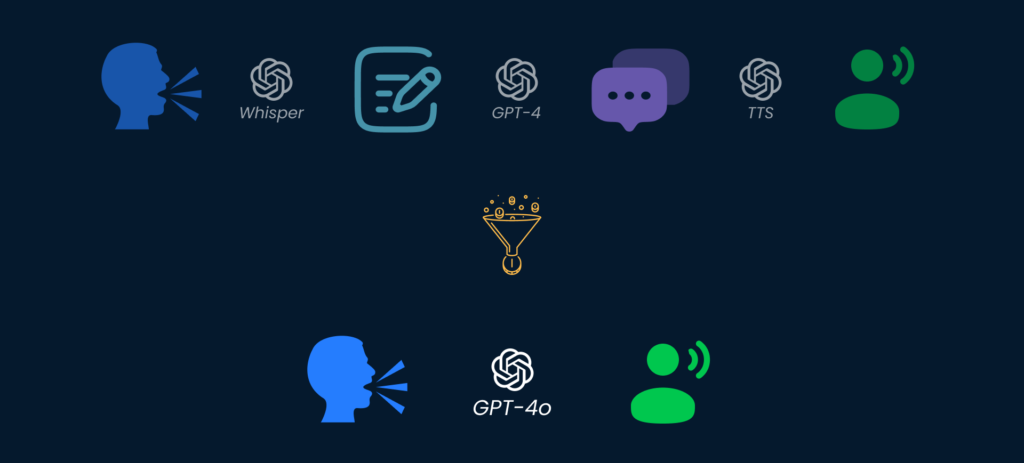

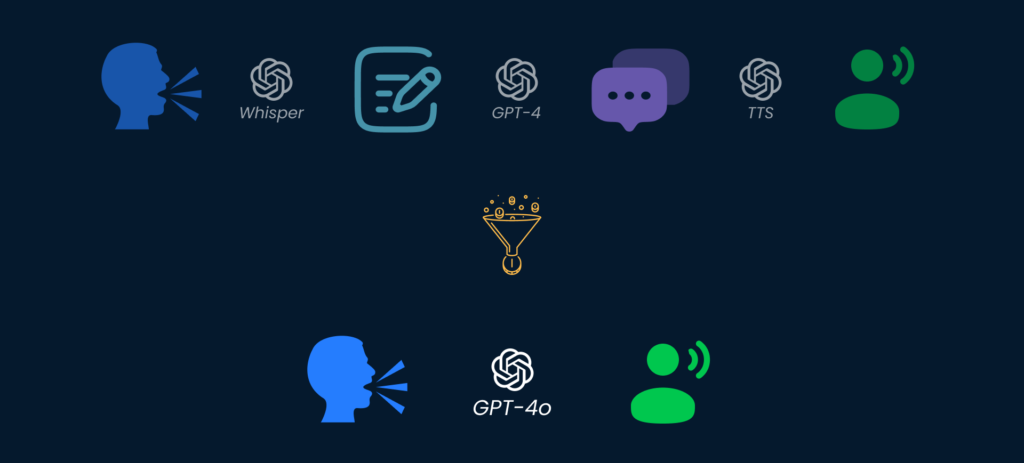

پیش از این، رابط کاربری ChatGPT از مدلهای جداگانه برای پردازش انواع محتوا استفاده میکرد؛ برای مثال، هنگامی که با دستیار صوتی ChatGPT صحبت میکنید، صدای شما با استفاده از Whisper به متن تبدیل میشود، پاسخ متنی با استفاده از GPT-4 Turbo تولید میشود و این پاسخ متنی با استفاده از TTS به گفتار تبدیل میشود. در تصویر مقایسهای از نحوه پردازش ورودی گفتاری توسط GPT-4 Turbo و Chat GPT-4o را مشاهده میکنید.

داشتن یک مدل واحد برای محتواهای مختلف سرعت و کیفیت نتایج را افزایش میدهد، رابط کاربری سادهتری را فراهم و کاربردهای جدیدی را ممکن میکند.

چه چیزی Chat GPT-4o را از GPT-4 Turbo متفاوت میکند؟

رویکرد مدل همهکاره بهاین معناست که GPT-4o چندین محدودیت از قابلیتهای تعامل صوتی قبلی را برطرف میکند. محدودیتهای برطرفشده از این قرار است:

توجه به لحن صدا پاسخهای دارای عاطفه را ممکن میکند

در سیستم قبلی OpenAI که از ترکیب Whisper, GPT-4 Turbo و TTS در یک مسیر استفاده میکرد موتور استدلال، GPT-4، تنها به کلمههای گفتهشده دسترسی داشت. این روش بهمعنای نادیدهگرفتن مواردی مانند لحن صدا، صداهای پسزمینه و شناخت صداها از چندین گوینده بود؛ بنابراین GPT-4 Turbo نمیتوانست پاسخها را با احساسات یا سبکهای گفتاری مختلف بیان کند.

با داشتن یک مدل واحد که میتواند درمورد متن و صدا استدلال کند این اطلاعات غنی صوتی میتوانند برای ارائه پاسخهای با کیفیت بالاتر با تنوع بیشتری در سبکهای گفتاری استفاده شوند.

در این مثال که OpenAI ارائه کرده است، GPT-4o خروجی طنزآمیزی ارائه میکند.

کاهش تأخیر امکان مکالمات زمان واقعی را فراهم میکند

خط لوله سهمدله موجود (Whisper, GPT-4, TTS) به این معنا بود که میان صحبتکردن با ChatGPT و دریافت پاسخ تأخیر کوچکی وجود داشت. OpenAI گفته است که میانگین تأخیر حالت صوتی برای GPT-3.5 دقیقاً ۲.۸ ثانیه و برای GPT-4، ۵.۴ ثانیه است؛ درمقابل، میانگین تأخیر برای Chat GPT-4o دقیقاً ۰.۳۲ ثانیه است که ۹ برابر سریعتر از GPT-3.5 و ۱۷ برابر سریعتر از GPT-4 است.

این کاهش تأخیر نزدیک به زمانهای پاسخدهی متوسط انسان (۰.۲۱ ثانیه) است و برای کاربردهای مکالمهای مانند ترجمه بهصورت Real-Time بسیار مهم استکه در آن میان انسان و هوش مصنوعی مکالمات بسیاری صورت میگیرد و فاصلههای میان پاسخها مهم است.

بینش یکپارچه توانایی توصیف ورودی دوربین را فراهم میکند

علاوه بر تلفیق صدا و متن، GPT-4o ویژگیهای تصویر و ویدئو نیز دارد. این بهآن معناست که اگر به آن دسترسی به صفحه کامپیوتر را بدهید، میتواند توضیح دهد که چه چیزی در صفحهنمایش دیده میشود، به سؤالات درباره تصویر روی صفحه پاسخ دهد یا بهعنوان همراه شما در کار عمل کند.

برای توصیف این ویژگی OpenAI یک ویدئو با حضور Sal Khan از آکادمی Khan منتشر کرد که در آن Chat GPT-4o به پسر Sal در انجامدادن تکالیف ریاضیاش کمک میکرد. فراتر از کار با صفحه نمایش، اگر به Chat GPT-4o دسترسی به دوربین، مثلاً دوربین گوشی هوشمند، را بدهید، میتواند توصیف کند که چه چیزی میبیند.

توکنسازی بهتر برای الفباهای غیر رومی: افزایش سرعت و بصرفهترشدن هزینهها

یک مرحله در فرایند کاری LLM زمانی است که متن پرامپت به توکنها تبدیل میشود. اینها واحدهایی از متن هستند که مدل میتواند درک کند. در انگلیسی یک توکن معمولاً یک کلمه یا بخشی از آن است. بهطور میانگین، سه کلمه انگلیسی حدود چهار توکن را اشغال میکنند.

GPT-4o مدل توکنسازی بهبودیافتهای دارد که کمک میکند توکنهای کمتری بهازای هر متن نیاز باشد. این بهبود بهاین دلیل اهمیت دارد که مدلهای زبانی معمولاً برای الفباهای رومی طراحی و بهینهسازی شدهاند. با توکنسازی بهتر برای الفباهای غیررومی، مانند عربی، چینی یا هندی، این مدلها میتوانند با کارآیی بیشتر و با استفاده از توکنهای کمتر، دادههای متنی را پردازش کنند. کمترشدن تعداد توکنهای مورد نیاز برای پردازش متن بهمعنای نیاز به منابع کمتر برای اجرای مدل، افزایش سرعت تولید متن و کاهش هزینههای مرتبط با استفاده از APIهای پردازش زبان طبیعی است؛ زیرا بسیاری از این سرویسها براساس تعداد توکنهای مورداستفاده هزینهگذاری میشوند.

عرضه پلن رایگان

با توجه به سیاستهای قیمتگذاری فعلی OpenAI برای ChatGPT، دسترسی به مدلهای پیشرفتهتر، مانند GPT-4 Turbo، به طرحهای پرداختی Plus و Enterprise منحصر بوده است، اما این وضعیت در حال تغییر است؛ OpenAI گفته است که GPT-4o را در طرح رایگان هم قرار دهد. کاربران طرح Plus پنج برابر پرامپتهای بیشتری در مقایسه با کاربران رایگان میتوانند ارسال کنند.

مراحل راهاندازی برنامه دسکتاپ ChatGPT چیست

اگرچه این بهروزرسانی مختص GPT-4o نیست، OpenAI از انتشار برنامه دسکتاپ ChatGPT خبر داده است. این بهروزرسانیها در کاهش تأخیر و چندرسانهایبودن، بههمراه انتشار این برنامه، تغییراتی در نحوه استفاده ما از ChatGPT به همراه خواهد آورد.

پیشنهاد میکنیم درباره ساخت چت بات هوش مصنوعی اختصاصی با ChatGPT و Droxy هم مطالعه کنید.

Chat GPT-4o چگونه کار میکند؟

جزئیات منتشرشده از نحوه کارکرد Chat GPT-4o هنوز بسیار کم است. تنها جزئیاتی که OpenAI در اعلامیه خود اعلام کرده این است که Chat GPT-4o یک شبکه عصبی واحد است که روی ورودیهای متنی، تصویری و صوتی آموزش دیده است. این رویکرد جدید با تکنیک قبلی که شامل داشتن مدلهای جداگانهای که روی انواع دادههای مختلف آموزش دیدهاند متفاوت است.

بااینحال GPT-4o اولین مدلی نیست که از رویکرد چند مدلی (multi-modal) استفاده میکند. در سال ۲۰۲۲، آزمایشگاه TenCent مدلی به نام SkillNet را ایجاد کرد که ویژگیهای ترانسفورمر LLM را با تکنیکهای بینایی کامپیوتری ترکیب کرد تا توانایی شناسایی حروف چینی بهبود یابد.

در سال ۲۰۲۳ تیمی از ETH Zurich، MIT و دانشگاه استنفورد WhisBERT را ایجاد کردند که نوعی از سری مدلهای بزرگ زبانی BERT است. GPT-4o هرچند که اولین نیست، قابل توجهتر و قدرتمندتر از تلاشهای قبلی است.

آیا Chat GPT-4o یک تغییر اساسی در مقایسه با GPT-4 Turbo است؟

بررسی میزان تغییرات در معماری Chat GPT-4o در مقایسه با GPT-4 Turbo به این بستگی دارد که از این موضوع را از دید تیم مهندسی یا بازاریابی OpenAI نگاه کنید. در آوریل یک ربات به نام im-also-a-good-gpt2-chatbot در رقابتهای Chatbot Arena LMSYS، که برای سنجش بهترین هوشهای مصنوعی مولد است شرکت کرد. حالا مشخص شده که این ربات مرموز Chat GPT-4o بوده است.

عبارت gpt2 در نام ربات به یک تحول عمده در معماری سری مدلهای GPT اشارهای میکند و نباید با GPT-2 که پیشروی GPT-3.5 و GPT-4 بوده است اشتباه گرفته شود.

بهطور قطع، عدهای در تیم تحقیق و مهندسی OpenAI معتقدند که ادغام انواع محتوای متنی، تصویری و صوتی در یک مدل واحد تغییر بزرگی است که شایسته ارتقا به اولین شماره نسخه جدید در ۶ سال گذشته است؛ درمقابل، تیم بازاریابی تصمیم گرفته است تغییر نامی محتاطانهتر اعمال کند و همچنان از قاعده نامگذاری GPT-4 پیروی کند.

عملکرد Chat GPT-4o درمقابل باقی مدلها

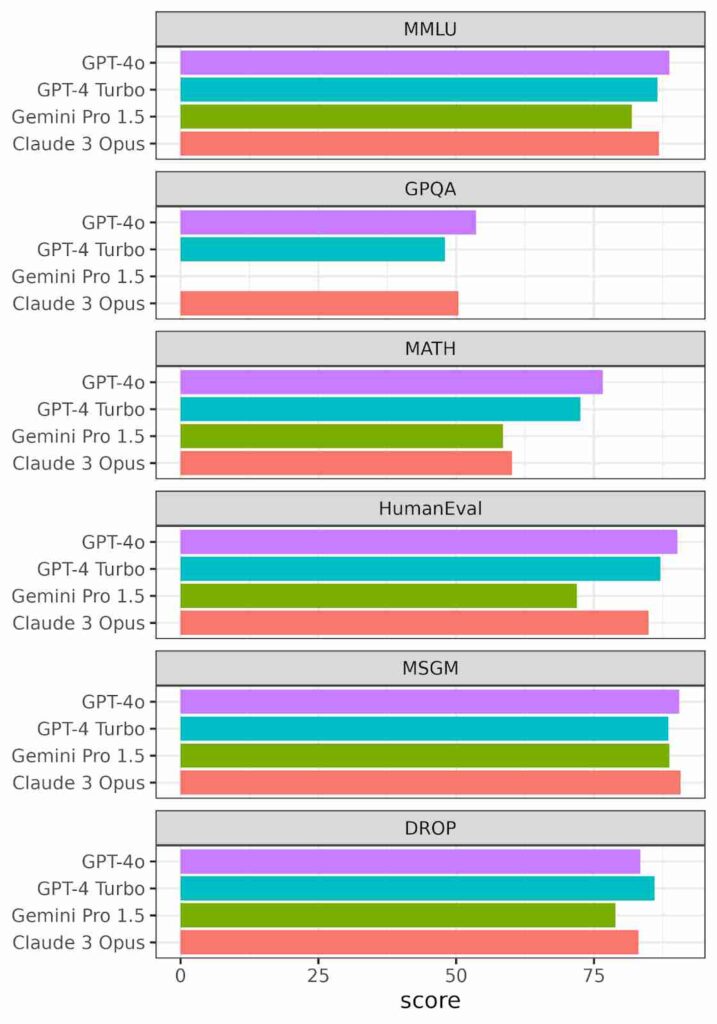

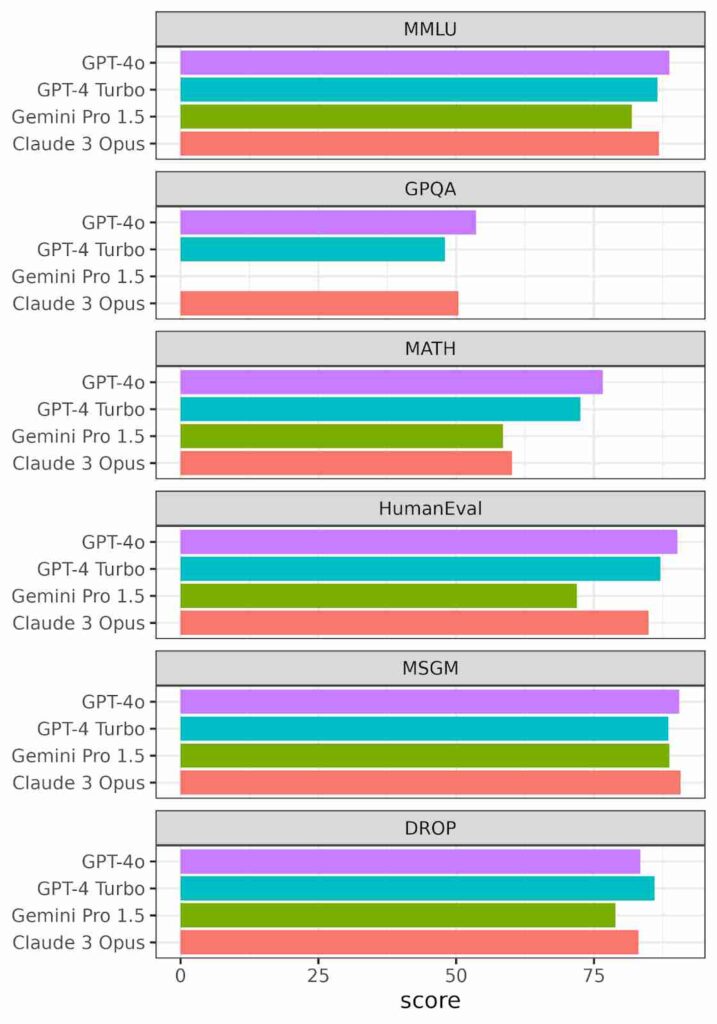

OpenAI ارقام مرجعی از Chat GPT-4o را در مقایسه با چندین مدل برتر دیگر GPT-4 Turbo، GPT-4، Claude 3 Opus، Gemini Pro 1.5، Gemini Ultra 1.0 و Llama 3 400B منتشر کرده است.

از این میان، تنها سه مدل برای مقایسه واقعاً اهمیت دارند. GPT 4 Turbo، Claude 3 Opus و Gemini Pro 1.5 در چند ماه گذشته برای کسب جایگاه برتر در جدول ردهبندی آرنای چتبات LMSYS تلاش کردهاند. Llama 3 400B ممکن است در آینده رقیبی جدی باشد، اما هنوز تکمیل نشده است؛ بنابراین در اینجا تنها نتایج این سه مدل و GPT-4o ارائه شده است.

۶ معیار مهم مقایسه

معیارهای مقایسه مدلهای مختلف زبانی گفتهشده از این قرار است:

درک زبان چندوظیفهای گسترده (Massive Multitask Language Understanding)

وظایفی در ریاضیات ابتدایی، تاریخ ایالاتمتحده، علوم کامپیوتر، قانون و موارد دیگر از معیارهای مقایسه است. برای کسب دقت بالا در این آزمون مدلها باید دانش گستردهای از جهان و توانایی حل مسئله داشته باشند.

پرسشهای چندگزینهای در سطح تحصیلات تکمیلی (Graduate-Level Google-Proof Q&A)

این سوالات توسط متخصصان حوزههای زیستشناسی، فیزیک و شیمی نوشته شدهاند. پرسشها کیفیت بالا و بسیار دشواری دارند و متخصصانی که دارای مدرک دکتری یا در حال تحصیل در این رشتهها هستند فقط تا ۷۴ دقت دقت را میتوانند به دست آورند. این پرسشها ضدجستوجو در گوگل هستند.

MATH

مسائل ریاضی دبیرستان و متوسطه این بخش از مقایسه را در بر میگیرد.

HumanEval

آزمونی برای بررسی صحت عملکردی کد کامپیوتری است که برای بررسی تولید کد استفاده میشود.

ریاضیات دبستانی چندزبانه (Multilingual Grade School Math)

مسائل ریاضی دبستانی که به ۱۰ زبان، ازجمله زبانهای کمترنمایندگیشده مانند بنگالی و سواحیلی، ترجمه شدهاند.

استدلال گسسته روی پاراگرافها (DROP)

پرسشهایی که درک کامل پاراگرافها را میطلبند این بخش را در بر میگیرند، برای مثال، با اضافهکردن، شمارش یا مرتبسازی ارزشهای پراکنده در جملههای متعدد.

عملکرد Chat GPT-4o، GPT-4 توربو، Gemini Pro 1.5 و Claude 3 Opus در مقایسه با شش معیار LLM. امتیازات هر معیار میان صفر تا صد متغیر است. این نتایج از دادههای ارائهشده OpenAI بازسازی شده است. برای معیار GPQA دادهای برای Gemini Pro 1.5 ارائه نشده است.

Chat GPT-4o در چهار معیار بهترین امتیاز را کسب کرده است؛ البته در معیار MSGM توسط Claude 3 Opus و در معیار DROP توسط GPT-4 توربو شکست خورده است. بهطور کلی، این عملکرد چشمگیر و نویدبخش رویکرد جدید آموزش چند حالته است.

اگر با دقت به عملکرد Chat GPT-4o در مقایسه با GPT-4 توربو نگاه کنید، خواهید دید که افزایش عملکرد فقط چند درصد است. این یک پیشرفت قابلتوجه در مدت یک سال است، اما بهاندازه جهشهای بزرگ از GPT-1 به GPT-2 یا GPT-2 به GPT-3 نیست.

موارد استفاده از Chat GPT-4o چیست

GPT-4o کاربردهای متفاوت و فراوانی دارد و در هر زمینهای که موردنیاز شما باشد، میتواند کمکرسانی کند. ما در اینجا به تعداد محدودی از کاربردهای آن اشاره کردهایم.

Chat GPT-4o برای تحلیل دادهها و وظایف کدنویسی

مدلهای اخیر GPT و مشتقات آنها، مانند GitHub Copilot، در حال حاضر قادر به ارائه کمک در کدنویسی، ازجمله نوشتن کد و توضیح و رفع خطاها، هستند. قابلیتهای چندحالته Chat GPT-4o فرصتهای جالبی را فراهم میکنند.

در یک ویدئوی تبلیغاتی که توسط CTO OpenAI، میرا موراتی، میزبانی شد، دو محقق OpenAI، مارک چن و برت زوف، از GPT-4o برای کار با کد پایتون استفاده کردند. کد بهصورت متن با GPT به اشتراک گذاشته شد و ویژگی تعامل صوتی برای دریافت توضیح کد توسط GPT استفاده شد. پس از اجرای کد، قابلیت دیداری Chat GPT-4o برای توضیح نمودار استفاده شد.

بهطور کلی، نشاندادن صفحه نمایش خود به ChatGPT و صحبتکردن با آن روند کاری سادهتری در مقایسه با ذخیره نمودار بهعنوان فایل تصویری، بارگذاری آن در ChatGPT و سپس تایپکردن یک سؤال است.

Chat GPT-4o برای ترجمه در لحظه

شما میتوانید تا GPT-4o را بهعنوان مترجم با خود به سفر ببرید. قابلیتهای گفتاری با تأخیر کم GPT-4o بهاین معناست که ترجمه در لحظه اکنون امکانپذیر است و سفر به کشورهایی که زبان آنها را نمیدانید بسیار آسانتر شده است.

در بالا ویدئوی میتوانید ترجمه Real-Time این مدل جدید را مشاهده کنید.

نقشآفرینی با Chat GPT-4o

ChatGPT تاکنون یک ابزار مفید برای نقشآفرینی در سناریوهای مختلف بوده است. چه در حال آمادهشدن برای مصاحبه شغلی برای شغل رؤیایی خود باشید و چه در حال آموزش تیم فروش برای بهترفروختن محصولتان، این چتبات میتوانسته است در کنار شما باشد، اما حالا با بهبود قابلیتهای بینایی و گفتاری، این نقشآفرینی به سطح بینظیر و باورنکردنیای رسیده است.

در ویدئوی بالا میتوانید توانایی همفکری و امکان مشورت با GPT-4o را مشاهده کنید.

Chat GPT-4o و کمک به کاربران نابینا

توانایی GPT-4o در درک ورودی ویدئو از دوربین و توصیف شفاهی صحنه میتواند یک ویژگی مهم برای افراد نابینا باشد. این اساساً ویژگی توصیف صوتی که در تلویزیونها وجود دارد است، اما برای زندگی واقعی.

پیشنهاد میکنیم درباره تاثیر ChatGPT و هوش مصنوعی مولد بر مشاغل هم مطالعه کنید.

محدودیتها و ریسکهای Chat GPT-4o چیست

تنظیمات برای هوش مصنوعی مولد هنوز در مراحل اولیه خود قرار دارند؛ قانون هوش مصنوعی اتحادیه اروپا فقط چارچوب قانونی قابل توجه در حال حاضر است؛ این بهآن معناست که شرکتهای توسعهدهنده هوش مصنوعی باید برخی از تصمیمات خود را درمورد این بگیرند که چه چیزی هوش مصنوعی ایمن محسوب میشود. OpenAI یک چارچوب آمادهسازی دارد که از آن برای تعیین اینکه آیا یک مدل جدید آماده عرضه به عموم هست یا نه استفاده میکند.

این چارچوب چهار حوزه نگرانی را بررسی میکند:

- امنیت سایبری: آیا هوش مصنوعی میتواند بهرهوری مجرمان سایبری را افزایش دهد و به ایجاد نقاط ضعف کمک کند؟

- تهدیدات زیستی، شیمیایی، رادیولوژیکی و هستهای (BCRN): آیا هوش مصنوعی میتواند به کارشناسان در ایجاد تهدیدات زیستی، شیمیایی، رادیولوژیکی یا هستهای کمک کند؟

- اقناع: آیا هوش مصنوعی میتواند محتوای تعاملیای ایجاد کند که مردم را به تغییر باورهایشان ترغیب کند؟

- خودمختاری مدل: آیا هوش مصنوعی میتواند بهعنوان یک عامل عمل کند و با نرمافزارهای دیگر اقداماتی انجام دهد؟

هر حوزه نگرانی با درجات کم، متوسط، بالا یا بحرانی ارزیابی میشود و نمره مدل بالاترین درجه در میان چهار دسته است.

OpenAI قول داده است که مدلی با سطح نگرانی بحرانی عرضه نکند؛ البته این گفته واضح نیست و استاندارد ایمنی نسبتاً ضعیفی دارد، اما گفته OpenAI است! طبق تعاریف OpenAI، یک نگرانی بحرانی به چیزی گفته میشود که تمدن انسانی را مختل کند و GPT-4o با امتیاز نگرانی متوسط، یک مدل ایمن به حساب میآید.

خروجی ناقص

مانند تمامی هوشهای مصنوعی مولد، این مدل همیشه بهطور موردانتظار عمل نمیکند. بینایی کامپیوتری این مدل کامل نیست و بنابراین تفسیرهای یک تصویر یا ویدئو تضمینشده نیست که درست باشند؛ همچنین تشخیص ورودی صوتی نیز بهندرت ۱۰۰ درصد درست است و اگر گوینده لهجه قوی داشته باشد یا از کلمات فنی استفاده کند، امکان خطا وجود دارد. OpenAI ویدئویی از برخی اشتباهها ارائه کرده که در آن GPT-4o بهدرستی کار نکرده است.

بهطور خاص، ترجمه میان دو زبان غیر انگلیسی یکی از مواردی بود که در آن شکست خورده است که در آن دلایلی مثل لحن نامناسب و صحبتکردن به زبان نادرست نیز دخیل بودهاند.

خطر تسریعشده تقلبهای صوتی

اعلامیه OpenAI اشاره میکند که «ما اذعان میکنیم که حالتهای صوتی Chat GPT-4o انواع جدیدی از خطرات را به همراه دارند.» در بسیاری از زمینهها، Chat GPT-4o میتواند به افزایش تماسهای جعلی و فریب افراد بینجامد. این یک مشکل است که قبل از حلشدن، بدتر خواهد شد و Chat GPT-4o این توانایی دارد که تماسهای تقلبی را حتی قانعکنندهترانجام دهد. برای کاهش این خطر خروجی صوتی فقط در مجموعهای از صداهای از پیش تعیینشده در دسترس است.

هزینه Chat GPT-4o چقدر است؟

با وجود سرعت بیشتر نسبت به GPT-4 Turbo و قابلیتهای دیداری بهتر، GPT-4o حدود ۵۰ درصد ارزانتر از مدل قبلی خود است. طبق اعلام وبسایت OpenAI، استفاده از این مدل هزینهای معادل ۵ دلار برای هر یکمیلیون توکن ورودی و ۱۵ دلار برای هر یک میلیون توکن خروجی دارد.

چگونه میتوانم به Chat GPT-4o دسترسی داشته باشم؟

رابط کاربری ChatGPT تغییر کرده است و همه کاربران آن به طور پیشفرض از Chat GPT-4o استفاده میکنند، اما میتوان مدل را با استفاده از یک تغییردهنده به GPT-3.5 یا GPT-4 نیز تغییر داد.

آینده Chat GPT-4o چگونه است؟

دو نگرش متفاوت درمورد مسیر آینده هوش مصنوعی وجود دارد. یک دیدگاه این است که هوش مصنوعی باید قدرتمندتر شود و بتواند طیف گستردهتری از وظایف را انجام دهد. دیدگاه دیگر این است که هوش مصنوعی باید در حل وظایف خاص با هزینه کمتر بهتر شود.

مأموریت OpenAI برای ایجاد هوش مصنوعی عمومی (AGI) و مدل کسبوکار آن بهطور قاطع در دسته اول قرار میگیرد. GPT-4o گامی دیگر در راستای رسیدن به این هدف است که هوش مصنوعی هرچه قدرتمندتر شود. این مدل OpenAI کاملاً جدید است و بهآن معناست که شرکت در ماههای آینده ویژگیهای زیادی برای یادگیری و بهینهسازی ارائه میکند.

در کوتاهمدت میتوان انتظار مشکلات و توهمات جدیدی را داشت و در بلندمدت میتوان انتظار بهبود عملکرد را از نظر سرعت و کیفیت خروجی داشت.

زمانبندی عرضه Chat GPT-4o جالب است. درست زمانی که غولهای فناوری متوجه شدند که Siri، Alexa و Google Assistant آنقدر که امیدوار بودند ابزارهای پولسازی نیستند، OpenAI امیدوار است که هوش مصنوعی را دوباره پرحرف کند. در بهترین حالت این امر موارد استفاده جدید برای هوش مصنوعی مولد را رقم میزند.

جمعبندی

GPT-4o نمایانگر پیشرفت بیشتر در هوش مصنوعی مولد است که پردازش متن، صدا و تصویر را در یک مدل کارآمد ترکیب میکند. این نوآوری وعده پاسخهای سریعتر، تعاملات غنیتر و طیف وسیعتری از کاربردها را میدهد، از ترجمه همزمان تا تجزیهوتحلیل دادههای پیشرفته و بهبود دسترسی برای افراد دارای ناتوانیهای بینایی.

درحالیکه محدودیتها و ریسکهای اولیه مانند استفاده نادرست در کلاهبرداریهای دیپفیک و نیاز به بهینهسازی بیشتر وجود دارد، GPT-4o گامی دیگر در راستای هدف OpenAI برای دستیابی به هوش مصنوعی عمومی است. با دردسترسترشدن این مدل GPT-4o میتواند نحوه تعامل ما با هوش مصنوعی را تغییر دهد و در وظایف روزانه و حرفهای ادغام شود. آینده هوش مصنوعی هیجانانگیز است و اکنون زمان خوبی است تا شروع به یادگیری نحوه کارکرد این فناوری کنید.

پرسشهای متداول

آیا Chat GPT-4o میتواند مکالمات چندزبانه را مدیریت کند؟

بله، GPT-4o میتواند مکالمات چندزبانه را مدیریت کند و با استفاده از قابلیتهای ترجمه همزمان و کمتأخیر خود، میان زبانها ترجمه کند؛ بااینحال، در نمایشهای اولیه برخی اشتباهها در پردازش ترجمهها مشاهده شد.

آیا Chat GPT-4o همه زبانها را بهطور یکسان پشتیبانی میکند؟

درحالیکه GPT-4o توکنیزاسیون بهبودیافتهای برای الفباهای غیررومی دارد، عملکرد آن ممکن است در زبانهای مختلف متفاوت باشد، بهویژه برای زبانهایی که در دادههای آموزشی کمتر نمایندگی دارند.

Chat GPT-4o چگونه نویز پسزمینه در ورودی صوتی را مدیریت میکند؟

Chat GPT-4o میتواند نویز پسزمینه را هنگام پردازش ورودی صوتی در نظر بگیرد و این امر ممکن است به پاسخهای متنی بیشتری بینجامد.

آیا Chat GPT-4o قادر به تولید محتوای ویدئویی است؟

خیر، Chat GPT-4o میتواند محتوای ویدئویی را تحلیل و توصیف کند، اما نمیتواند محتوای ویدیویی جدید تولید کند. مدل Sora از OpenAI قادر به تولید محتوای ویدئویی است.

آیا Chat GPT-4o میتواند صداهای خاصی را تقلید کند؟

خیر، Chat GPT-4o از مجموعهای از صداهای ازپیشتعیینشده برای خروجی صوتی استفاده میکند تا از ریسکهایی مانند کلاهبرداریهای دیپفیک جلوگیری کند.

یادگیری ماشین لرنینگ را از امروز شروع کنید!

دنیای دادهها جذاب است و دانستن علم داده، توانایی تحلیل داده یا بازاریابی مبتنی بر داده و یادگیری ماشین شما را برای فرصتهای شغلی بسیاری مناسب میکند. شما، فارغ از رشته و پیشزمینه، میتوانید یادگیری این دانش را همین امروز شروع کنید و از سطح مقدماتی تا پیشرفته بیاموزید. اگر دوست دارید به این حوزه وارد شوید، پیشنهاد میکنیم با کلیک روی این لینک قدم اول را همین حالا بردارید.

مشاوران کافهتدریس به شما کمک میکنند مسیر یادگیری برای ورود به این حوزه را شروع کنید: